Solutions · Vidéo

Six fonctions pour la stack vidéo de flotte.

Connecter n'importe quelle caméra. Enregistrer sur événement. Diffusion en direct. Récupérer un clip. Réveil sur événement. Exécuter l'IA sur les octets. Un OS, six pages fonctionnelles.

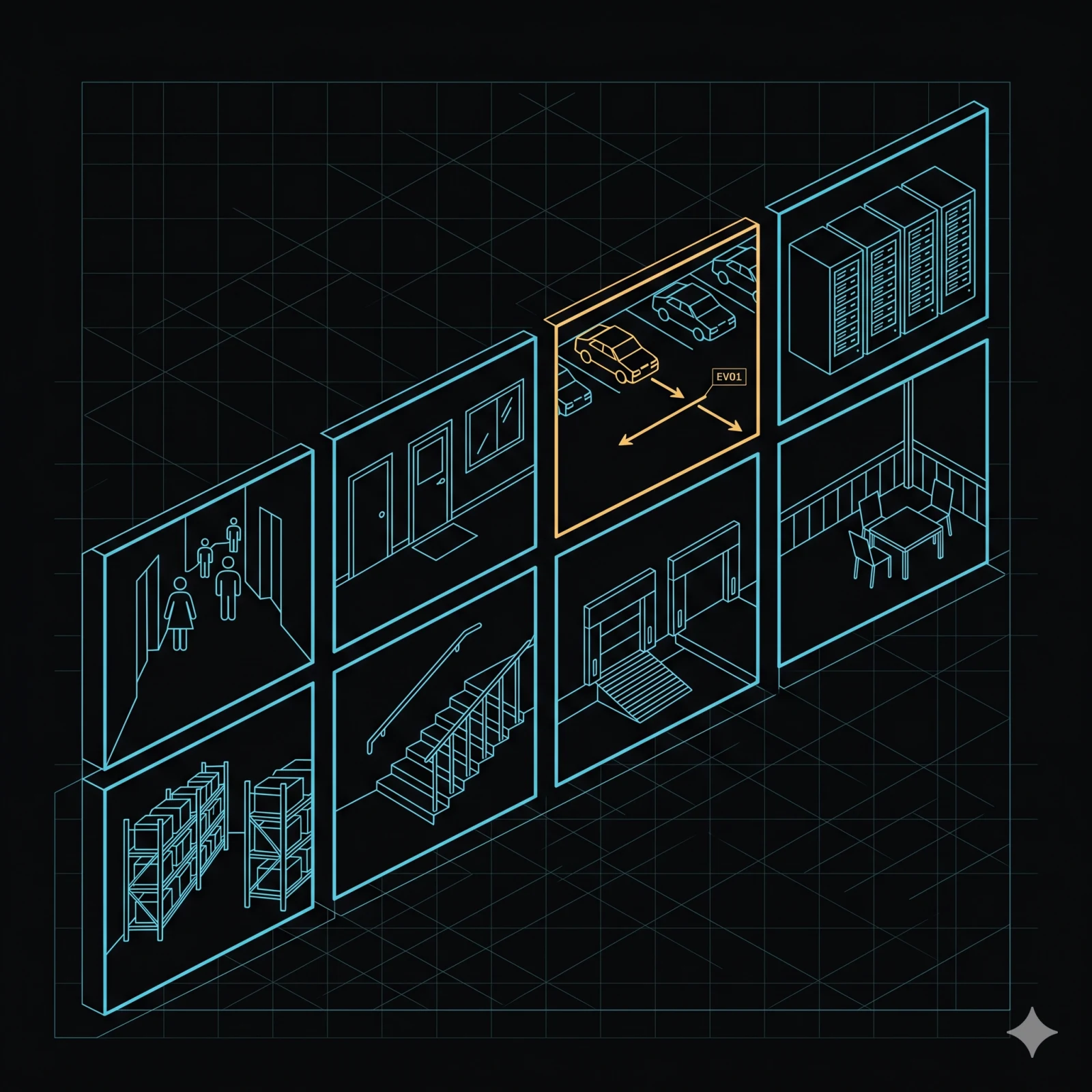

Carte des fonctions

Choisissez la tâche. Accédez à sa page.

Connecter n'importe quelle caméra

Cinq transports — MIPI-CSI, GMSL2, USB UVC, RTSP/ONVIF, WebRTC — derrière une seule service de contrôle de capture. Deux familles de SoC. Hot-plug. Backend sélectionné à l'exécution.

Enregistrer sur événement

Segments FIFO rotatifs + clips signalés par événement protégés contre la suppression. Index de segment SQLite sans écriture flash lors d'un enregistrement normal. Anonymisation RGPD en direct dans le pipeline de capture.

Diffusion en direct

WebRTC (WHEP), RTSP / RTSPS et SRT pour la longue distance à faible latence sur cellulaire avec pertes. Lecture compatible navigateur. La signalisation est prise en charge par l'élément source et le pair distant.

Récupérer un clip

Sept opérations de service — GetSegments, ExtractClip, Snapshot, Protect, Unprotect, Remove, Upload. Extraction de clip par copie de flux (sans décodage/ré-encodage). Upload SFTP avec épinglage de clé hôte et mp4-reduce.

Réveil sur événement

Sept sources de réveil — Allumage, Alarme, RTC, trame CAN, Mouvement, Modem, Perturbation. Délai de mise en service inférieur à cinq secondes — assez rapide pour rattraper un véhicule en fuite.

Exécuter l'IA sur les octets

Triage NPU on-device aujourd'hui ; IA cloud sur les clips uploadés fusionnés avec le flux d'événements du cycle de vie — comportement conducteur, DTC, position OBD, pose GNSS. Conforme RGPD par flou au moment de la capture.

Comment ça s'articule

Un pipeline, six fonctions.

La caméra produit des frames zero-copy dans le bus de frames ; le bus distribue vers l'encodeur, le NPU et la diffusion ; l'encodeur alimente l'index dashcam, qui alimente l'upload SFTP, qui alimente l'IA cloud ; l'IA cloud reçoit aussi les détections NPU.

flowchart LR C[Caméra<br/>MIPI · GMSL · UVC · RTSP · WebRTC] F[Bus de frames<br/>zero-copy DMABuf · fanout 1:N] E[Encodeur<br/>segments H.264] N[NPU<br/>triage on-device] S[Diffuser<br/>WebRTC · RTSP · SRT] D[Index dashcam<br/>SQLite · zéro écriture flash] U[Upload SFTP<br/>clé hôte épinglée] X[IA cloud<br/>par clip + fusion lifecycle] C --> F --> E --> D --> U --> X F --> N --> X F --> S

FAQ

Foire aux questions

-

La stack vidéo fonctionne-t-elle sur du matériel modem-class ?

La capture et l'enregistrement dashcam fonctionnent sur des appareils compute-class. L'inférence NPU (mos-roi-shader, mos-ai-runtime) nécessite du silicium AI-class — il n'y a pas de fallback CPU en production.

-

Où se déroule l'anonymisation RGPD ?

Dans le pipeline de capture, avant qu'une image n'atteigne l'encodeur, le runtime IA ou tout consommateur. Les segments enregistrés sont déjà conformes ; les consommateurs en aval reçoivent des frames pré-floutées.

-

Dois-je écrire du code d'encodeur ou de pipeline ?

Non. mos-camera-capture gère le pipeline GStreamer de bout en bout — démarrage, arrêt, récupération d'erreur, hot-plug — sur cinq transports et deux familles de SoC.

-

Quelle est la différence entre l'intégration dashcam externe en marque blanche et l'enregistrement interne ?

mos-dashcam est l'enregistreur interne gamma ; dashcam-controller est le composant BETA qui pilote le matériel dashcam externe en marque blanche via Wi-Fi HTTP et notification TCP. Les deux peuvent coexister sur le même véhicule.

Apportez deux caméras et un cas d'usage.

Transport de capture, stratégie d'enregistrement, protocole en direct, source de réveil, modèle IA — apportez ce que vous avez et nous esquisserons le pipeline pendant l'appel.