Soluciones · Vídeo

Seis funciones para el stack de vídeo de flota.

Conectar cualquier cámara. Grabar por evento. Transmisión en vivo. Recuperar un clip. Despertar por evento. Ejecutar IA sobre los bytes. Un OS, seis páginas funcionales.

Mapa de funciones

Elige la tarea. Accede a su página.

Conectar cualquier cámara

Cinco transportes — MIPI-CSI, GMSL2, USB UVC, RTSP/ONVIF, WebRTC — detrás de una sola servicio de control de captura. Dos familias de SoC. Hot-plug. Backend seleccionado en tiempo de ejecución.

Grabar por evento

Segmentos FIFO rotativos + clips señalados por evento protegidos contra eliminación. Índice de segmentos SQLite con cero escrituras en flash durante la grabación normal. Anonimización RGPD en vivo en el pipeline de captura.

Transmisión en vivo

WebRTC (WHEP), RTSP / RTSPS y SRT para baja latencia de larga distancia sobre celular con pérdidas. Reproducción compatible con navegador. La señalización es gestionada por el elemento fuente y el par remoto.

Recuperar un clip

Siete operaciones de servicio — GetSegments, ExtractClip, Snapshot, Protect, Unprotect, Remove, Upload. Extracción de clip por copia de flujo (sin decodificación/recodificación). Carga SFTP con anclaje de clave de host y mp4-reduce.

Despertar por evento

Siete fuentes de despertar — Encendido, Alarma, RTC, trama CAN, Movimiento, Módem, Perturbación. Tiempo hasta listo inferior a cinco segundos — suficientemente rápido para alcanzar un vehículo en fuga.

Ejecutar IA sobre los bytes

Clasificación NPU on-device hoy; IA en la nube sobre clips subidos fusionados con el flujo de eventos del ciclo de vida — comportamiento del conductor, DTC, posición OBD, pose GNSS. Conforme RGPD por difuminado en tiempo de captura.

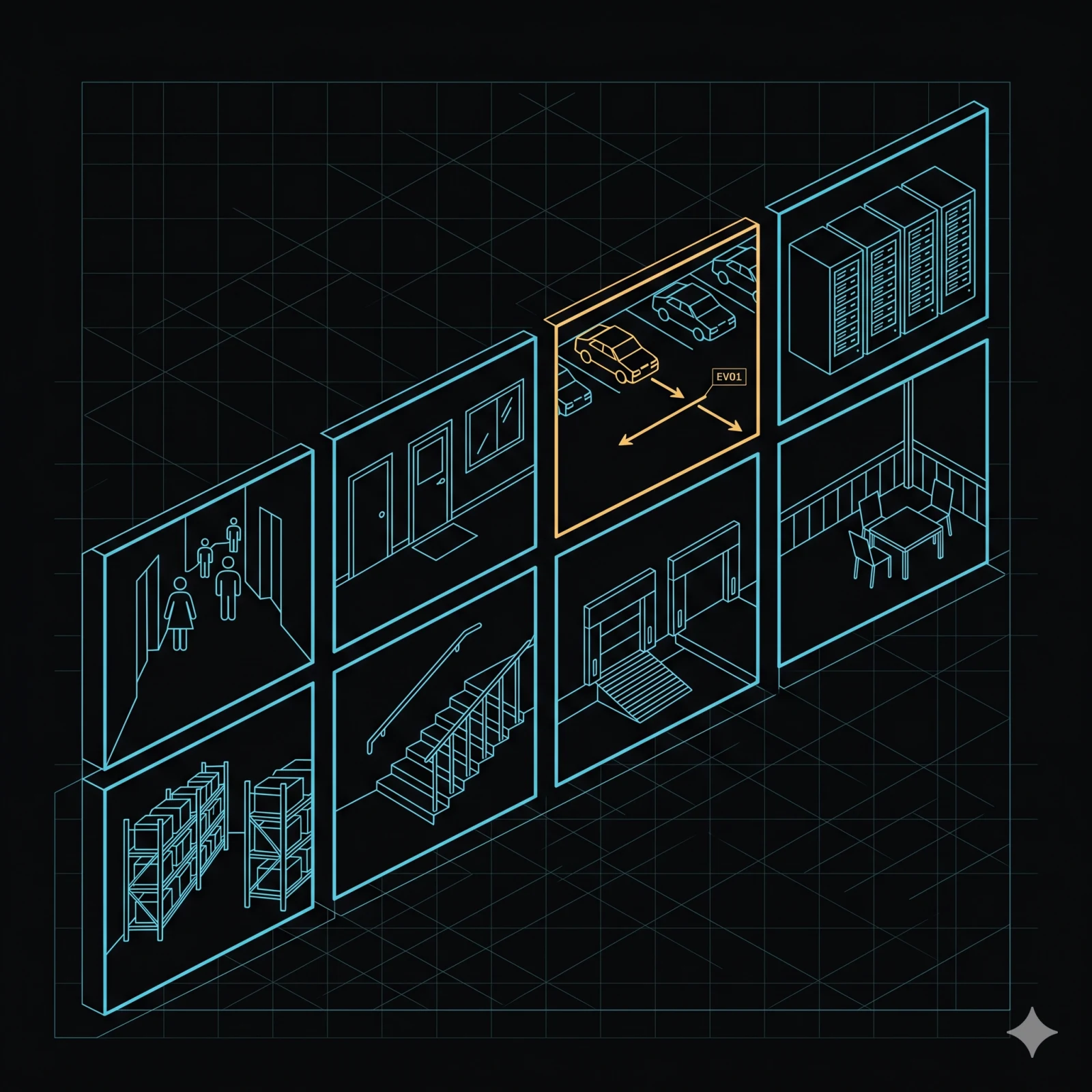

Cómo encaja

Un pipeline, seis funciones.

La cámara produce frames zero-copy en el bus de frames; el bus distribuye al codificador, NPU y transmisión; el codificador alimenta el índice dashcam, que alimenta la carga SFTP, que alimenta la IA en la nube; la IA en la nube también recibe detecciones NPU.

flowchart LR C[Cámara<br/>MIPI · GMSL · UVC · RTSP · WebRTC] F[Bus de frames<br/>zero-copy DMABuf · fanout 1:N] E[Codificador<br/>segmentos H.264] N[NPU<br/>clasificación on-device] S[Transmitir<br/>WebRTC · RTSP · SRT] D[Índice dashcam<br/>SQLite · cero escrituras flash] U[Carga SFTP<br/>clave de host anclada] X[IA en la nube<br/>por clip + fusión lifecycle] C --> F --> E --> D --> U --> X F --> N --> X F --> S

Preguntas frecuentes

Preguntas frecuentes

-

¿El stack de vídeo funciona con hardware modem-class?

La captura y la grabación dashcam funcionan en dispositivos compute-class. La inferencia NPU (mos-roi-shader, mos-ai-runtime) requiere silicio AI-class — no hay fallback de CPU en producción.

-

¿Dónde ocurre la anonimización RGPD?

Dentro del pipeline de captura, antes de que cualquier frame llegue al codificador, al runtime de IA o a cualquier consumidor. Los segmentos grabados ya son conformes; los consumidores posteriores reciben frames pre-difuminados.

-

¿Tengo que escribir código de codificador o de pipeline?

No. mos-camera-capture gestiona el pipeline GStreamer de extremo a extremo — inicio, parada, recuperación de errores, hot-plug — en cinco transportes y dos familias de SoC.

-

¿Cuál es la diferencia entre la integración de dashcam externa de marca blanca y la grabación interna?

mos-dashcam es el grabador interno gamma; dashcam-controller es el componente BETA que controla hardware dashcam externo de marca blanca vía Wi-Fi HTTP y notificación TCP. Ambos pueden coexistir en el mismo vehículo.

Trae dos cámaras y un caso de uso.

Transporte de captura, estrategia de grabación, protocolo en vivo, fuente de despertar, modelo de IA — trae lo que tienes y esbozaremos el pipeline durante la llamada.